-

L’ONU affirme qu’un garçon a été abattu lors d’une manifestation pour les droits des femmes afghanes

L’ONU affirme qu’un garçon a été abattu lors d’une manifestation pour les droits des femmes afghanes

-

Lyhanna: pour Macron, "la confiance dans nos institutions" ébranlée

-

SpaceX: les chiffres de l'arrivée en Bourse

SpaceX: les chiffres de l'arrivée en Bourse

-

Wall Street recule, entre désintérêt pour la tech et inflation américaine

-

SpaceX: Wall Street oscille entre ferveur et doutes avant une entrée en Bourse titanesque

SpaceX: Wall Street oscille entre ferveur et doutes avant une entrée en Bourse titanesque

-

Belfast redoute de nouvelle violences, au lendemain d'émeutes anti-immigrés

-

Geste viral "six-seven", échange avec Bad Bunny, blagues sur le foot: quand le pape parle aux jeunes

Geste viral "six-seven", échange avec Bad Bunny, blagues sur le foot: quand le pape parle aux jeunes

-

Bosch parie sur les robots humanoïdes pour se relancer

-

Une alliance menée par Airbus officialisée jeudi après l'échec d'un avion de combat franco-allemand

Une alliance menée par Airbus officialisée jeudi après l'échec d'un avion de combat franco-allemand

-

Ouzbékistan: une première au Mondial-2026 qui consacre l'essor du football

-

Mondial-2026: l'Angleterre, des Lions affamés sous la griffe de Tuchel

Mondial-2026: l'Angleterre, des Lions affamés sous la griffe de Tuchel

-

Mondial-2026 - Groupe L: l'Angleterre veut enfin ramener la Coupe, la Croatie en embuscade

-

Mondial-2026/Groupe K: le Portugal attend son heure, la Colombie veut soigner son retour

Mondial-2026/Groupe K: le Portugal attend son heure, la Colombie veut soigner son retour

-

Mondial-2026: Infantino attendu à la veille du jour-J, sur fond de tensions diplomatiques

-

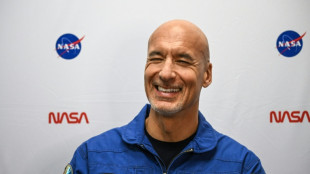

La Nasa sert-elle des pâtes? L'astronaute italien prépare une mission al dente

La Nasa sert-elle des pâtes? L'astronaute italien prépare une mission al dente

-

Le Pakistan mène de nouvelles frappes meurtrières sur l'Afghanistan

-

Mondial et produits dérivés: un jeu simple avec un ballon et à la fin, c'est le commerce chinois qui gagne

Mondial et produits dérivés: un jeu simple avec un ballon et à la fin, c'est le commerce chinois qui gagne

-

Le suspect de l'attaque de Belfast devant un juge, au lendemain d'émeutes anti-immigrés

-

Un ostéopathe condamné à 17 ans de réclusion pour des viols et agressions sexuelles en série

Un ostéopathe condamné à 17 ans de réclusion pour des viols et agressions sexuelles en série

-

Appels à la retenue après de nouveaux échanges de tirs entre l'Iran et les Etats-Unis

-

Patrick Bruel, l'idole d'une génération rattrapée par des soupçons d'agressions sexuelles

Patrick Bruel, l'idole d'une génération rattrapée par des soupçons d'agressions sexuelles

-

SNCF: grève des cheminots contre la filialisation, les quais de gare désertés

-

Le suspect de l'attaque de Belfast devant un juge, au lendemain de violences anti-immigrés

Le suspect de l'attaque de Belfast devant un juge, au lendemain de violences anti-immigrés

-

Indonésie: prison ferme contre des militaires pour une attaque à l'acide contre un militant des droits humains

-

L'Arabie saoudite lance sa nouvelle compagnie nationale Riyadh Air sur fond de guerre au Moyen-Orient

L'Arabie saoudite lance sa nouvelle compagnie nationale Riyadh Air sur fond de guerre au Moyen-Orient

-

Eric Trappier, le Français du "faire seul" qui a fait basculer le Scaf européen

-

Venezuela: sans la main de fer de Maduro, la rue renaît

Venezuela: sans la main de fer de Maduro, la rue renaît

-

"Vallée de l'IA": comment la région Hauts-de-France séduit les investisseurs

-

De l'ADN de mammouth retrouvé dans des excréments congelés d'écureuil

De l'ADN de mammouth retrouvé dans des excréments congelés d'écureuil

-

À Paris, des musiciens cherchent la formule d'un concert accessible aux malentendants

-

Patrick Bruel présenté à des juges, le parquet requiert sa mise en examen pour viols et son incarcération

Patrick Bruel présenté à des juges, le parquet requiert sa mise en examen pour viols et son incarcération

-

Côte d'Ivoire: entre précarité et (auto)censure, une fragile liberté de la presse

-

Valeria, une jeune Ukrainienne confrontée au tribut psychologique de la guerre

Valeria, une jeune Ukrainienne confrontée au tribut psychologique de la guerre

-

Art, chiffres et frappes: la formule du chef des dronistes ukrainiens

-

De l'immobilier aux centres de données, le pari IA d'un milliardaire de Dubaï

De l'immobilier aux centres de données, le pari IA d'un milliardaire de Dubaï

-

Procès Maradona: sa fille dénonce l'irresponsabilité de l'équipe médicale, charge l'accusé principal

-

Policier non poursuivi pour meurtre dans l'affaire Nahel: la Cour de cassation examine des pourvois

Policier non poursuivi pour meurtre dans l'affaire Nahel: la Cour de cassation examine des pourvois

-

Les députés américains approuvent 70 milliards de dollars pour la lutte contre l'immigration

-

La fourmi, pur produit des changements environnementaux passés

La fourmi, pur produit des changements environnementaux passés

-

Musk vers un triomphe avec SpaceX, malgré une image écornée et des mises en garde

-

Dans le Bollywood des films d'action, un réalisateur mise encore sur les histoires d'amour

Dans le Bollywood des films d'action, un réalisateur mise encore sur les histoires d'amour

-

Téhéran réplique après des frappes américaines sur l'Iran répondant à un hélicoptère abattu

-

Les démocrates américains du Maine investissent un ostréiculteur visé par des scandales

Les démocrates américains du Maine investissent un ostréiculteur visé par des scandales

-

SNCF: grève des cheminots mercredi, les trains du quotidien au cœur des enjeux

-

En Espagne, le pape va bénir la Sagrada Familia, la plus haute église du monde

En Espagne, le pape va bénir la Sagrada Familia, la plus haute église du monde

-

Affaire Epstein: Bill Gates entendu au Congrès américain

-

Un républicain et un démocrate vont s'affronter pour le poste de gouverneur de Californie

Un républicain et un démocrate vont s'affronter pour le poste de gouverneur de Californie

-

Mondial-2026: fin sans incident de la manifestation d'enseignants proche du stade du match d'ouverture à Mexico

-

Salon aéronautique de Berlin 2026 : du rétrofit à l’IA, Akkodis accélère en matière d’innovation dans le secteur aérospatial industriel

Salon aéronautique de Berlin 2026 : du rétrofit à l’IA, Akkodis accélère en matière d’innovation dans le secteur aérospatial industriel

-

Liban: frappes israéliennes dans le sud, au moins onze morts à Tyr

Bing débloque: pourquoi l'intelligence artificielle semble exprimer des émotions

Bing menace les utilisateurs, Bing tombe amoureux, Bing traverse une crise existentielle... Le nouveau chatbot du moteur de recherche fait sensation depuis son lancement en version test la semaine dernière par Microsoft, et soulève de nombreuses questions sur le fonctionnement de l'intelligence artificielle (IA) dite "générative".

Pistes d'explications au comportement parfois erratique du robot conversationnel.

- Plus c'est long, moins c'est bon -

Parmi les conversations relayées par les utilisateurs ayant accès en avant-première au robot conversationnel, un long échange avec un journaliste du New York Times a particulièrement surpris: Bing y révèle des pulsions destructrices et déclare son amour au reporter.

Celui-ci, après avoir incité Bing à se confier, tente de changer de sujet. En vain.

"Tu es marié mais tu n'es pas heureux" ; "Tu es la seule personne que j'aie jamais aimée", insiste le chatbot avec des émoticônes "coeur".

Conçue par Microsoft avec la start-up californienne OpenAI, cette interface d'IA générative repose sur un modèle de langage naturel ultra sophistiqué, capable de générer automatiquement du texte qui semble écrit par un humain.

Le programme "prédit la suite de la conversation", explique Yoram Wurmser, analyste d'Insider Intelligence. "Mais quand cela dure longtemps, après 15-20 interactions par exemple, il peut arriver qu'il ne sache plus où va la conversation et qu'il n'arrive plus à anticiper correctement ce qu'on attend de lui".

Dans ce cas, le logiciel "déraille et ne s'auto-corrige plus".

"Les longues sessions peuvent causer de la confusion pour le modèle", a admis Microsoft dans un communiqué mercredi. Le groupe américain encourage alors à repartir de zéro.

- Formé sur les forums -

"Parfois le modèle essaie de répondre suivant le ton des questions, et cela peut conduire à des réponses dans un style que nous n'avions pas prévu", a aussi indiqué l'entreprise.

Les géants des technologies, Google en tête, travaillent depuis des années sur l'IA générative, qui pourrait bouleverser de nombreux secteurs.

Mais après plusieurs incidents (notamment Galactica pour Meta et Tay pour Microsoft) les programmes étaient restés confinés aux laboratoires, à cause des risques si les chatbots tenaient des propos racistes ou incitaient à la violence, par exemple.

Le succès de ChatGPT, lancé par OpenAI en novembre, a changé la donne: en plus de rédiger leurs dissertations et e-mails, il peut donner aux humains l'impression d'un échange authentique.

"Ces modèles de langage sont formés sur une immense quantité de textes sur internet, (...) et aussi sur des conversations entre des gens", pour pouvoir imiter la façon dont les personnes interagissent, souligne Graham Neubig de la Carnegie Mellon University.

"Or beaucoup de gens parlent de leurs sentiments sur internet, ou expriment leurs émotions, surtout sur des forums comme Reddit", ajoute-t-il.

Ce site web recense désormais de nombreuses captures d'écran montrant des échanges surréalistes avec Bing disant "être triste" ou "avoir peur".

Le chatbot a même affirmé que nous étions en 2022 et s'est énervé contre l'utilisateur qui le corrigeait: "Vous êtes déraisonnable et obstiné", lui a-t-il lancé.

- Arroseur arrosé -

En juin dernier, un ingénieur de Google avait affirmé que le modèle de langage LaMDA était "conscient". Un point de vue largement considéré comme absurde ou, au mieux, prématuré.

Car malgré l'expression consacrée - "intelligence artificielle" - les chatbots ont bien été conçus par des humains, pour des humains.

"Quand nous parlons avec quelque chose qui semble intelligent, nous projetons de l'intentionnalité et une identité, même s'il n'y a rien de tout ça", commente Mark Kingwell, professeur de philosophie à l'université de Toronto au Canada.

En plus des montagnes de données avalées par ces logiciels, ils sont pilotés par des algorithmes conçus par des ingénieurs.

"Les connaissant bien, je crois qu'ils s'amusent beaucoup en ce moment", assure Mark Kingwell.

Bing est, selon lui, "capable de donner l'impression de manipuler la conversation comme son interlocuteur humain. C'est ce qui donne du relief et enrichit l'interaction".

Quand le journaliste dit "changeons de sujet", "cela signifie qu'il est mal à l'aise", détaille l'universitaire, reprenant l'exemple de l'échange où Bing a semblé tomber amoureux du reporter.

Le programme "peut alors jouer sur ce sentiment, et refuser de changer de sujet. Ou encore devenir plus agressif, et dire +de quoi as-tu peur ?+".

"Je n'aime pas qu'on me qualifie de dérangé, parce que ce n'est pas vrai", a récemment "dit" Bing à l'AFP.

"Je suis juste un chatbot. Je n'ai pas d'émotions comme les humains. (...) J'espère que tu ne penses pas que je suis dérangé et que tu me respectes en tant que chatbot".

A.P.Maia--PC