-

Mimit, prezzo medio gasolio a 2,02 euro, self benzina a 1,74

Mimit, prezzo medio gasolio a 2,02 euro, self benzina a 1,74

-

Sci: Braathen in testa al gigante di Lillehammer, azzurri indietro

-

Fsb, riforme finanza rallentano ma multilateralismo è chiave

Fsb, riforme finanza rallentano ma multilateralismo è chiave

-

Ivass, a fine 2024 in calo cause pendenti per Rc auto e natanti

-

Verso bucati green con sola acqua grazie a uno spray antimacchia

Verso bucati green con sola acqua grazie a uno spray antimacchia

-

Gme, prezzo elettricità in aumento a 149,04 euro al MWh

-

Nba: Detroit ferma i Lakers, San Antonio continua la corsa

Nba: Detroit ferma i Lakers, San Antonio continua la corsa

-

Sci: gigante di Lillehammer, fuori Odermatt e coppa a rischio

-

Borsa: Milano prosegue positiva, in luce Inwit

Borsa: Milano prosegue positiva, in luce Inwit

-

Sinner 'sono felice, ma non gioco per i record'

-

Borsa: l'Europa apre positiva in attesa di sviluppi tra Usa e Iran

Borsa: l'Europa apre positiva in attesa di sviluppi tra Usa e Iran

-

Dopo attacchi Iran Israele bombarda Teheran

-

Revolut, utile 2025 balza a 1,3 miliardi di sterline, +46% ricavi

Revolut, utile 2025 balza a 1,3 miliardi di sterline, +46% ricavi

-

Lo spread tra Btp e Bund apre in lieve rialzo a 88 punti

-

Iliad, nel 2025 raddoppia l'utile a 752 milioni

Iliad, nel 2025 raddoppia l'utile a 752 milioni

-

Prezzo oro in calo, Spot scambiato a 4.386 dollari

-

Prezzo petrolio risale, Wti scambiato a 90,90 dollari

Prezzo petrolio risale, Wti scambiato a 90,90 dollari

-

Il mercato auto europeo +1,7% a febbraio, per Stellantis balzo del 9,5%

-

L'italiana Cardoletti nuova guida dell'Unhcr in Messico

L'italiana Cardoletti nuova guida dell'Unhcr in Messico

-

Aereo militare caduto in Colombia, il bilancio sale ad almeno 66 morti e decine di feriti

-

Sheinbaum su Cuba: 'No a un'invasione, no a soluzioni violente'

Sheinbaum su Cuba: 'No a un'invasione, no a soluzioni violente'

-

Tennis: Miami, Sinner batte 6-1 6-4 il francese Moutet e va agli ottavi

-

Colombia: aereo militare precipitato in Amazzonia, sale a 34 il bilancio dei morti

Colombia: aereo militare precipitato in Amazzonia, sale a 34 il bilancio dei morti

-

Maduro si allena in carcere 'come un atleta' in attesa dell'udienza di giovedì

-

Borsa: Tokyo, apertura in rialzo (+1,73%)

Borsa: Tokyo, apertura in rialzo (+1,73%)

-

Cuba nega la scarcerazione all'artista oppositore Otero Alcántara

-

Media, 'Usa valutano presidente del Parlamento iraniano come potenziale leader'

Media, 'Usa valutano presidente del Parlamento iraniano come potenziale leader'

-

Miami Open, Cerundolo batte a sorpresa Medvedev

-

Aereo militare precipita in Colombia, 8 morti e oltre 80 feriti

Aereo militare precipita in Colombia, 8 morti e oltre 80 feriti

-

Wp, 'improbabile raggiungere fine del regime e stop a nucleare in Iran'

-

Audi Q9: quanto sarà realistica?

Audi Q9: quanto sarà realistica?

-

Lecce: altro infortunio muscolare, per Berisha stagione finita

-

Dacia Striker: Bella e robusta?

Dacia Striker: Bella e robusta?

-

Il ritorno di Paola Cortellesi da regista, 'presto, io continuo'

-

Skoda Peaq: Nuovo SUV elettrico a 7 posti

Skoda Peaq: Nuovo SUV elettrico a 7 posti

-

Sparati via da impatti, così batteri possono viaggiare tra pianeti

-

Campagna Chanel con Margot Robbie, canta Kylie Minogue

Campagna Chanel con Margot Robbie, canta Kylie Minogue

-

Gellar, oggi sul set le attrici possono sentirsi più al sicuro

-

Netanyahu sente Trump, 'tuteleremo i nostri interessi in qualsiasi situazione'

Netanyahu sente Trump, 'tuteleremo i nostri interessi in qualsiasi situazione'

-

Fregatura alla pompa

-

Londra convoca ambasciatore Iran, 'basta destabilizzazione Gb'

Londra convoca ambasciatore Iran, 'basta destabilizzazione Gb'

-

Gassman, 'felicissimo per il successo di Guerrieri, faremo la seconda serie'

-

Tennis: Miami; doppio, Errani/Paolini volano ai quarti

Tennis: Miami; doppio, Errani/Paolini volano ai quarti

-

Investire su IA e quantum per arrivare alle prime centrali per la fusione

-

Prova della Mercedes GLC elettrica

Prova della Mercedes GLC elettrica

-

Lo spread tra Btp e Bund chiude in calo a 87 punti

-

Torna Red Bull Bc one Cypher Italy, i migliori breaker italiani si sfidano a l'Aquila

Torna Red Bull Bc one Cypher Italy, i migliori breaker italiani si sfidano a l'Aquila

-

Borsa: l'Europa chiude in rialzo con Trump su Iran e Hormuz

-

Una primavera di grandi concerti, su tivusat si festeggiano i 90 anni di Zubin Mehta

Una primavera di grandi concerti, su tivusat si festeggiano i 90 anni di Zubin Mehta

-

L'effetto brucia-grassi innescato da una staffetta di batteri dell'intestino e dieta

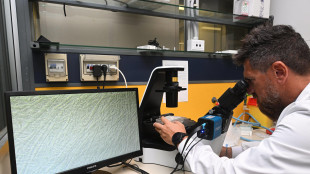

La capacità di giudizio dell'IA è solo apparenza

Grandi rischi nel delegare scelte e giudizi agli Llm

La capacità di giudizio dei modelli linguistici come ChatGpt o Gemini è solo apparenza: a dimostrarlo è lo studio guidato da Walter Quattrociocchi, dell'Università Sapienza di Roma, e pubblicato sulla rivista dell'Accademia Nazionale degli Stati Uniti Pnas. Un lavoro che sottolinea i rischi concreti di affidare a questi modelli di Intelligenza Artificiale la delega di fare scelte o prendere decisioni. "Cosa avviene realmente quando chiediamo a un'IA di eseguire una scelta, ad esempio determinare se una notizia del web sia credibile o è piuttosto una fake news?", ha detto Quattrociocchi all'ANSA per raccontare il nuovo studio che ha eseguito una serie di test a gran parte dei più importanti modelli linguisti Llm in circolazione, come ChatGpt, Gemini, Llama, Deepseek e Mistral. Un lungo lavoro che ha messo a confronto umani e IA per capire le differenze di 'ragionamento' dei due. "Quello che abbiamo messo qui molto bene in evidenza è che nonostante i risultati, le IA riconosco infatti molto bene le fake news, il meccanismo che utilizzano non si basa però su riscontri reali ma su una mera capacità di simulare i giudizi. In altre parole, i giudizi formulati dagli Llm sono plausibili ma disancorati dalla realtà fattuale". Una sostituzione della verità con la plausibilità che in un futuro non molto lontano, sottolineano gli autori, potrebbe portare a problemi gravi quando gradualmente daremo sempre più autorevolezza alle capacità degli Llm di gestire azioni o prendere scelte per noi, in totale delega. "Ma questi sistemi sembrano valutare come noi solo perché simulano le tracce del pensiero, non il pensiero stesso", ha aggiunto il ricercatore italiano. "Questo studio - ha concluso - dimostra che ciò che stiamo automatizzando non è il giudizio, ma la sua apparenza".

A.Santos--PC