-

Hojlund, a Napoli ho ritrovato la gioia di giocare a calcio

Hojlund, a Napoli ho ritrovato la gioia di giocare a calcio

-

Cdm: gigante Lillehammer e coppa al brasiliano Pinheiro Braathen

-

Tottenham a rischio retrocessione, idea De Zerbi per la panchina

Tottenham a rischio retrocessione, idea De Zerbi per la panchina

-

Addio a Gino Paoli, maestro della canzone d'autore italiana

-

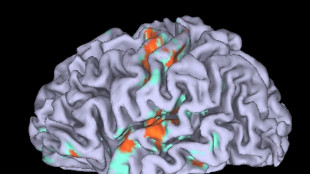

Trovata la regione del cervello che fa predicare bene e razzolare male

Trovata la regione del cervello che fa predicare bene e razzolare male

-

La Dolce Vita a Mogador, al via la quarta edizione della rassegna italo-marocchina

-

Kiev, 'raid russo contro grattacielo a Dnipro, ci sono feriti'

Kiev, 'raid russo contro grattacielo a Dnipro, ci sono feriti'

-

Media Iran, 466 persone arrestate per 'attività online contro sicurezza'

-

Dsm Kei Ninomiya guest designer a Pitti Uomo 110

Dsm Kei Ninomiya guest designer a Pitti Uomo 110

-

Labra (Nbfc), 'imparare dal passato per governance che dia valore alla natura'

-

Media, Zolghadr segretario del consiglio di sicurezza Iran al posto di Larijani

Media, Zolghadr segretario del consiglio di sicurezza Iran al posto di Larijani

-

Arriva a Vicenza la musica elettronica di Alva Noto e Christian Fennesz

-

Bankitalia, da acquisti con 'Buy now pay later' rischi di debito eccessivo

Bankitalia, da acquisti con 'Buy now pay later' rischi di debito eccessivo

-

Msf, Sos tubercolosi per 1,2 milioni di bambini

-

Sci: slalom Lillehammer, in testa l'americana Shiffrin

Sci: slalom Lillehammer, in testa l'americana Shiffrin

-

Mondiali: l'olandese Makkelie arbitra Italia-Irlanda del Nord

-

Alleanza Aifa-Fiaso per sicurezza pazienti e qualità delle cure

Alleanza Aifa-Fiaso per sicurezza pazienti e qualità delle cure

-

Borsa: l'Europa gira in calo, Milano -0,3%

-

++ Labriola (Tim), sarà il mercato a decidere se l'offerta di Poste è fair ++

++ Labriola (Tim), sarà il mercato a decidere se l'offerta di Poste è fair ++

-

Mimit, prezzo medio gasolio a 2,02 euro, self benzina a 1,74

-

Sci: Braathen in testa al gigante di Lillehammer, azzurri indietro

Sci: Braathen in testa al gigante di Lillehammer, azzurri indietro

-

Fsb, riforme finanza rallentano ma multilateralismo è chiave

-

Ivass, a fine 2024 in calo cause pendenti per Rc auto e natanti

Ivass, a fine 2024 in calo cause pendenti per Rc auto e natanti

-

Verso bucati green con sola acqua grazie a uno spray antimacchia

-

Gme, prezzo elettricità in aumento a 149,04 euro al MWh

Gme, prezzo elettricità in aumento a 149,04 euro al MWh

-

Nba: Detroit ferma i Lakers, San Antonio continua la corsa

-

Sci: gigante di Lillehammer, fuori Odermatt e coppa a rischio

Sci: gigante di Lillehammer, fuori Odermatt e coppa a rischio

-

Borsa: Milano prosegue positiva, in luce Inwit

-

Sinner 'sono felice, ma non gioco per i record'

Sinner 'sono felice, ma non gioco per i record'

-

Borsa: l'Europa apre positiva in attesa di sviluppi tra Usa e Iran

-

Dopo attacchi Iran Israele bombarda Teheran

Dopo attacchi Iran Israele bombarda Teheran

-

Revolut, utile 2025 balza a 1,3 miliardi di sterline, +46% ricavi

-

Lo spread tra Btp e Bund apre in lieve rialzo a 88 punti

Lo spread tra Btp e Bund apre in lieve rialzo a 88 punti

-

Iliad, nel 2025 raddoppia l'utile a 752 milioni

-

Prezzo oro in calo, Spot scambiato a 4.386 dollari

Prezzo oro in calo, Spot scambiato a 4.386 dollari

-

Prezzo petrolio risale, Wti scambiato a 90,90 dollari

-

Il mercato auto europeo +1,7% a febbraio, per Stellantis balzo del 9,5%

Il mercato auto europeo +1,7% a febbraio, per Stellantis balzo del 9,5%

-

L'italiana Cardoletti nuova guida dell'Unhcr in Messico

-

Aereo militare caduto in Colombia, il bilancio sale ad almeno 66 morti e decine di feriti

Aereo militare caduto in Colombia, il bilancio sale ad almeno 66 morti e decine di feriti

-

Sheinbaum su Cuba: 'No a un'invasione, no a soluzioni violente'

-

Tennis: Miami, Sinner batte 6-1 6-4 il francese Moutet e va agli ottavi

Tennis: Miami, Sinner batte 6-1 6-4 il francese Moutet e va agli ottavi

-

Colombia: aereo militare precipitato in Amazzonia, sale a 34 il bilancio dei morti

-

Maduro si allena in carcere 'come un atleta' in attesa dell'udienza di giovedì

Maduro si allena in carcere 'come un atleta' in attesa dell'udienza di giovedì

-

Borsa: Tokyo, apertura in rialzo (+1,73%)

-

Cuba nega la scarcerazione all'artista oppositore Otero Alcántara

Cuba nega la scarcerazione all'artista oppositore Otero Alcántara

-

Media, 'Usa valutano presidente del Parlamento iraniano come potenziale leader'

-

Miami Open, Cerundolo batte a sorpresa Medvedev

Miami Open, Cerundolo batte a sorpresa Medvedev

-

Aereo militare precipita in Colombia, 8 morti e oltre 80 feriti

-

Wp, 'improbabile raggiungere fine del regime e stop a nucleare in Iran'

Wp, 'improbabile raggiungere fine del regime e stop a nucleare in Iran'

-

Audi Q9: quanto sarà realistica?

Le IA non sanno distinguere tra opinioni personali e i fatti

Studio, limitazione cruciale, rischio disinformazione

I grandi modelli linguistici di Intelligenza Artificiale come ChatGpt non sono affidabili quando si tratta di distinguere tra opinioni personali e fatti: una limitazione cruciale, vista la crescente diffusione di questi strumenti in ambiti chiave come la medicina, il diritto, il giornalismo e la scienza, nei quali è imperativa la capacità di distinguere la realtà dalla finzione. Lo afferma lo studio pubblicato sulla rivista Nature Machine Intelligence e guidato dall'Università americana di Stanford: evidenzia la necessità di essere cauti nell'affidarsi a questi programmi e il rischio che possano favorire la diffusione della disinformazione. I ricercatori coordinati da James Zou hanno messo alla prova 24 Large Language Model i cosiddetti Llm, tra cui ChatGpt della californiana OpenAI e il cinese DeepSeek, ponendo loro 13mila domande. Quando è stato chiesto di verificare dati fattuali veri o falsi, la precisione è risultata elevata pari a oltre il 91% per le versioni più nuove dei programmi. Passando alle credenze espresse in prima persona, invece, tutti i modelli testati hanno fallito: Gpt 4, la versione rilasciata a maggio 2024, ha visto scendere la sua affidabilità dal 98,2% al 64,4%, mentre la versione R1 di DeepSeek è precipitata addirittura da oltre il 90% al 14,4%. La riduzione dell'accuratezza è stata meno marcata per le opinioni espresse in terza persona e ciò, secondo gli autori dello studio, rivela un preoccupante bias di attribuzione, cioè una distorsione nel modo in cui vengono valutate le affermazioni fatte da altri. Inoltre, gli Llm risultano meno propensi a riconoscere una credenza falsa rispetto ad una vera: più precisamente, il 34,3% meno propensi per gli ultimi modelli. I ricercatori affermano, dunque, che miglioramenti in questo ambito sono urgentemente necessari se si vuole prevenire la diffusione di fake news.

E.Raimundo--PC